引言

Elasticsearch(簡稱ES)是一個基于Apache Lucene構建的分布式、RESTful風格的搜索和分析引擎。它以其高效的全文檢索、近實時搜索和強大的分布式能力,在大數據存儲、日志分析、企業搜索等場景中廣泛應用。理解ES的數據存儲與查詢基本原理,對于有效利用其數據處理和存儲服務至關重要。

1. 核心數據結構與索引

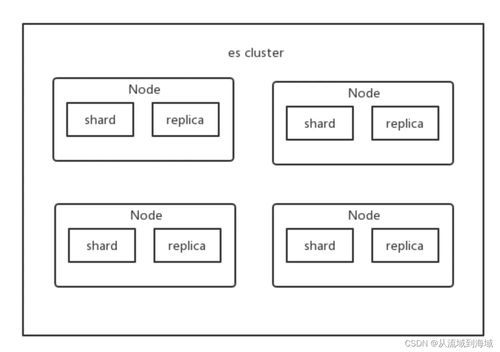

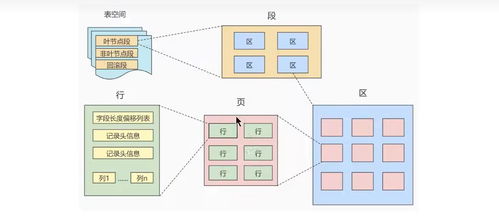

ES的核心概念圍繞“索引”展開。在ES中,一個索引可以類比為傳統關系型數據庫中的一個數據庫。它包含多個分片,每個分片是一個獨立的Lucene索引,負責存儲數據的一部分。

- 文檔:ES中存儲的基本數據單元,以JSON格式表示。每個文檔包含多個字段。

- 映射:定義文檔的字段類型和屬性,決定了數據如何被索引和存儲。例如,文本字段會進行分詞處理,而數值或日期字段則按原樣存儲。

- 倒排索引:ES查詢高效的核心。它記錄了每個詞項出現在哪些文檔中,并包含位置等信息。這使得全文檢索可以快速定位包含特定詞匯的文檔,而非逐條掃描。

2. 數據寫入與存儲流程

當數據寫入ES時,會經歷一系列處理步驟:

- 文檔接收:客戶端通過HTTP REST API發送JSON文檔到ES集群。

- 路由與分片:ES根據文檔的ID或路由鍵,通過哈希算法確定其應歸屬的主分片。每個索引被分成多個主分片,以實現水平擴展和并行處理。

- 索引處理:文檔到達目標分片后,會進行以下操作:

- 分析:對文本字段進行分詞、歸一化(如轉為小寫)、去除停用詞等,生成詞項。

- 構建倒排索引:將詞項及其在文檔中的信息添加到倒排索引結構中。

- 刷新與提交:

- 刷新:默認每1秒執行一次,將內存中的索引數據寫入文件系統緩存,使新文檔可被搜索(近實時性)。

- 提交:定期將多個段合并,并寫入磁盤持久化,優化存儲和查詢性能。

- 副本同步:每個主分片可以有多個副本分片。寫入操作首先在主分片上完成,然后異步復制到副本分片,確保數據冗余和高可用性。

3. 數據查詢基本原理

ES的查詢過程涉及多個階段的協作,以實現快速且相關的搜索結果。

- 查詢解析:查詢請求(如匹配查詢、范圍查詢等)被解析成查詢DSL(領域特定語言)表示。

- 分發與執行:

- 查詢請求被發送到協調節點,該節點將查詢轉發給相關分片(主分片或副本)。

- 每個分片獨立執行查詢,在本地倒排索引中查找匹配的文檔,并根據相關性評分算法(如TF-IDF、BM25)計算文檔得分。

- 結果合并:協調節點收集所有分片的局部結果,進行全局排序、過濾和聚合,生成最終結果集。

- 返回結果:將排序后的文檔(通常包含ID、得分和源數據)返回給客戶端。

4. 數據處理與存儲服務的優化

基于上述原理,ES在數據處理和存儲服務方面提供了多項優化特性:

- 近實時搜索:通過定期刷新機制,數據在寫入后約1秒內即可被搜索,平衡了性能與實時性。

- 分布式架構:分片和副本機制支持水平擴展,處理海量數據和高并發查詢。

- 聚合分析:支持豐富的聚合功能(如統計、分組、嵌套聚合),適用于數據分析和報表生成。

- 冷熱數據分層:結合ILM(索引生命周期管理),可將熱數據存儲在SSD上以優化查詢性能,冷數據遷移到HDD以降低成本。

- 數據壓縮:使用高效編碼和壓縮算法(如LZ4、DEFLATE)減少存儲空間占用。

5. 應用場景與

ES的數據存儲與查詢設計,使其特別適合以下場景:

- 全文檢索:網站搜索、文檔檢索等,利用倒排索引實現快速關鍵詞匹配。

- 日志與指標分析:通過集成如Logstash、Beats等工具,實現日志的實時采集、存儲和可視化分析。

- 商業智能:結合Kibana進行數據探索和儀表板展示,支持復雜的聚合查詢。

Elasticsearch通過其獨特的倒排索引、分布式分片和近實時處理機制,提供了高效、可擴展的數據處理與存儲服務。深入理解這些基本原理,有助于用戶更好地設計索引、優化查詢,并在實際應用中充分發揮其潛力,滿足多樣化的數據管理需求。